Все мы знаем, что искусственный интеллект призван стать прорывом нашего века. Однако Илон Маск давно предупреждал об опасности того, что искусственный интеллект станет слишком умным. из-за отсутствия контроля, и наступит время, когда он ускользнет из наших рук, и мы больше не сможем контролировать это.

Искусственный интеллект призван стать прорывом нашего века. В нашем обществе приключения меняются так сильно, что они тоже несут в себе огромные опасности. Великие гуру технологий видят опасности иначе.

Марк Цукерберг, генеральный директор и создатель Facebook, и Илон Маск, генеральный директор Tesla и Space X, столкнулись в эти дни в социальных сетях из-за своего разного видения опасностей искусственного интеллекта. Борьба, которая только посеет новые сомнения в будущем технологий.

Илон Маск давно предупреждал об опасности того, что искусственный интеллект станет слишком умным, потому что отсутствия контроля, и наступит время, когда он ускользнет из наших рук, и мы больше не сможем контролировать Это. Если искусственный интеллект становится умнее нас и преследует интересы, отличные от наших… Кто его держит? Сегодня компьютеры контролируют атомные электростанции, водоснабжение или светофоры в городах. Что, если искусственный интеллект станет опытным хакером? Это опасности, которые бросили на стол не только Илон Маск, один из величайших провидцев нашего времени.

В одной из своих знаменитых трансляций в Facebook в саду своего дома Марк Цукерберг несколько дней назад ответил на вопрос об искусственном интеллекте. Он сказал следующее об Илоне Маске: «Я на днях смотрел интервью с Илоном Маском, и его самый большой страх за будущее - это искусственный интеллект». Я настроен оптимистично. Я думаю, что вы можете создавать вещи, чтобы сделать мир лучше. Который пытается создать апокалиптические сценарии, я не понимаю. Это очень негативно и в некоторых аспектах я считаю очень безответственным.

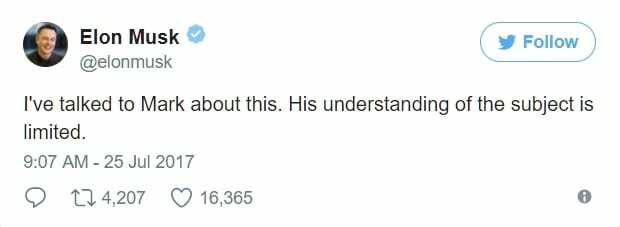

Кто-то дал Илону Маску эти комментарии в Twitter, и он ответил сегодня в социальной сети: «Я говорил с Марком на эту тему. Его знание предмета ограничено ».

Реальность такова, что все технологические компании интегрируют искусственный интеллект во все свои продукты. Особенно технологический гигант Google и гигант социальных сетей Facebook, которые уже используют его в проектах большая глубина, такая как улучшение здравоохранения или создание автономных автомобилей, проекты, которые могут спасти тысячи жизни.

Но они также интегрируют его в свои социальные сети, чтобы облегчить поиск, просматривать содержание фотографий, интерпретировать то, что пользователи делают (и, следовательно, получают больше информации о нас), и им неудобно отрицательно говорить об Искусственном Интеллект.

Илон Маск также является одним из пионеров этой технологии, массово используя ее в интеллектуальном вождении своего автомобиля Tesla. электромобили или космические ракеты, которые дозаправляют Международную космическую станцию, и отправятся на Марс в будущее. Но его видение искусственного интеллекта гораздо более пессимистично и тревожно.

Искусственный интеллект все еще находится в зачаточном состоянии, и очень сложно предсказать, как он будет развиваться. Это не вопрос мнения, а вопрос наличия в ваших силах инструментов создания более совершенного искусственного интеллекта, чтобы знать, что с ними можно сделать. То, что глубоко знают только некоторые привилегированные, в том числе Цукерберг и Маск. Мы разделяем оптимизм основателя видения Facebook, но когда настоящие провидцы, такие как Илон Маск и Билл Гейтс, которые развивают больше всего продвинутый искусственный интеллект в мире в своих компаниях, или один из самых продвинутых умов нашего времени, Стивен Хокинг, предупреждает об опасностях искусственного Интеллект. Так что стоит отнестись к этому очень серьезно !!!

Теперь проблемы искусственного интеллекта другие. Возможно, он еще не в состоянии уничтожить человечество, но прямо сейчас он используется, чтобы шпионить за нами, контролировать нас или делать расистские и сексистские комментарии.

так что ты думаешь об этом? Просто поделитесь своими взглядами и мыслями в разделе комментариев ниже.