hadoop adalah kerangka kerja pemrograman open source yang dikembangkan oleh apache untuk memproses data besar. Ini menggunakan HDFS (Sistem File Terdistribusi Hadoop) untuk menyimpan data di semua datanode di cluster secara distributif dan memetakan model untuk memproses data.

Node nama (NN) adalah daemon utama yang mengontrol HDFS dan Pelacak pekerjaan (JT) adalah daemon master untuk mesin mapreduce.

Dalam tutorial ini saya menggunakan dua CentOS 6.3 VM ‘menguasai' dan 'simpul' yaitu. (master dan node adalah nama host saya). IP 'master' adalah 172.21.17.175 dan IP simpul adalah ‘172.21.17.188‘. Instruksi berikut juga berfungsi pada RHEL/CentOS 6.x versi.

[[dilindungi email] ~]# nama host menguasai

[[dilindungi email] ~]# ifconfig|grep 'inet addr'|head -1 inet addr:172.21.17.175 Bcast: 172.21.19.255 Topeng: 255.255.252.0

[[dilindungi email] ~]# nama host simpul

[[dilindungi email] ~]# ifconfig|grep 'inet addr'|head -1 inet addr:172.21.17.188 Bcast: 172.21.19.255 Topeng: 255.255.252.0

Pertama pastikan bahwa semua host cluster ada di ‘/etc/hosts' (pada setiap node), jika Anda tidak memiliki pengaturan DNS.

[[dilindungi email] ~]# cat /etc/hosts 172.21.17.175 master. 172.21.17.188 simpul

[[dilindungi email] ~]# cat /etc/hosts 172.21.17.197 qabox. 172.21.17.176 landasan yang memungkinkan

Kami menggunakan resmi CDH repositori untuk menginstal CDH4 pada semua host (Master dan Node) dalam sebuah cluster.

Pergi ke resmi Unduh CDH halaman dan ambil CDH4 (mis. 4.6) versi atau Anda dapat menggunakan berikut wget perintah untuk mengunduh repositori dan menginstalnya.

#wget http://archive.cloudera.com/cdh4/one-click-install/redhat/6/i386/cloudera-cdh-4-0.i386.rpm. # yum --nogpgcheck localinstall cloudera-cdh-4-0.i386.rpm

#wget http://archive.cloudera.com/cdh4/one-click-install/redhat/6/x86_64/cloudera-cdh-4-0.x86_64.rpm. # yum --nogpgcheck localinstall cloudera-cdh-4-0.x86_64.rpm

Sebelum menginstal Hadoop Multinode Cluster, tambahkan Cloudera Public GPG Key ke repositori Anda dengan menjalankan salah satu perintah berikut sesuai dengan arsitektur sistem Anda.

## pada Sistem 32-bit ## # rpm --import http://archive.cloudera.com/cdh4/redhat/6/i386/cdh/RPM-GPG-KEY-cloudera

## pada Sistem 64-bit ## # rpm --import http://archive.cloudera.com/cdh4/redhat/6/x86_64/cdh/RPM-GPG-KEY-cloudera

Selanjutnya, jalankan perintah berikut untuk menginstal dan mengatur JobTracker dan NameNode di server Master.

[[dilindungi email] ~]# yum bersihkan semua [[dilindungi email] ~]# yum install hadoop-0.20-mareduce-jobtracker

[[dilindungi email] ~]# yum bersih semua. [[dilindungi email] ~]# yum install hadoop-hdfs-namenode

Sekali lagi, jalankan perintah berikut di server Master untuk menyiapkan node nama sekunder.

[[dilindungi email] ~]# yum bersihkan semua [[dilindungi email] ~]# yum install hadoop-hdfs-secondarynam

Selanjutnya, atur tasktracker & datanode pada semua host cluster (Node) kecuali host JobTracker, NameNode, dan Sekunder (atau Standby) NameNode (pada node dalam kasus ini).

[[dilindungi email] ~]# yum bersih semua. [[dilindungi email] ~]# yum install hadoop-0.20-mapreduce-tasktracker hadoop-hdfs-datanode

Anda dapat menginstal klien Hadoop di mesin terpisah (dalam hal ini saya telah menginstalnya di datanode Anda dapat menginstalnya di mesin apa pun).

[[dilindungi email] ~]# yum install hadoop-client

Sekarang jika kita selesai dengan langkah-langkah di atas, mari kita maju untuk menyebarkan hdfs (harus dilakukan pada semua node).

Salin konfigurasi default ke /etc/hadoop direktori ( pada setiap node dalam cluster ).

[[dilindungi email] ~]# cp -r /etc/hadoop/conf.dist /etc/hadoop/conf.my_cluster

[[dilindungi email] ~]# cp -r /etc/hadoop/conf.dist /etc/hadoop/conf.my_cluster

Menggunakan alternatif perintah untuk mengatur direktori kustom Anda, sebagai berikut ( pada setiap node dalam cluster ).

[[dilindungi email] ~]# alternatif --verbose --install /etc/hadoop/conf hadoop-conf /etc/hadoop/conf.my_cluster 50. membaca /var/lib/alternatives/hadoop-conf [[dilindungi email] ~]# alternatif --set hadoop-conf /etc/hadoop/conf.my_cluster

[[dilindungi email] ~]# alternatif --verbose --install /etc/hadoop/conf hadoop-conf /etc/hadoop/conf.my_cluster 50. membaca /var/lib/alternatives/hadoop-conf [[dilindungi email] ~]# alternatif --set hadoop-conf /etc/hadoop/conf.my_cluster

Sekarang buka 'inti-situs.xml'file dan perbarui'fs.defaultFS” pada setiap node dalam cluster.

[[dilindungi email] conf]# cat /etc/hadoop/conf/core-site.xml

1.0 teks/xslkonfigurasi.xsl fs.defaultFS hdfs://master/

[[dilindungi email] conf]# cat /etc/hadoop/conf/core-site.xml

1.0 teks/xslkonfigurasi.xsl fs.defaultFS hdfs://master/

Pembaruan berikutnya “dfs.permissions.superusergroup" di dalam hdfs-site.xml pada setiap node dalam cluster.

[[dilindungi email] conf]# cat /etc/hadoop/conf/hdfs-site.xml

1.0 teks/xslkonfigurasi.xsl dfs.name.dir /var/lib/hadoop-hdfs/cache/hdfs/dfs/name dfs.permissions.superusergroup hadoop

[[dilindungi email] conf]# cat /etc/hadoop/conf/hdfs-site.xml

1.0 teks/xslkonfigurasi.xsl dfs.name.dir /var/lib/hadoop-hdfs/cache/hdfs/dfs/name dfs.permissions.superusergroup hadoop

Catatan: Pastikan bahwa, konfigurasi di atas ada di semua node (lakukan pada satu node dan jalankan scp untuk menyalin pada sisa node).

Update “dfs.name.dir atau dfs.namenode.name.dir” di ‘hdfs-site.xml’ pada NameNode ( pada Master dan Node ). Harap ubah nilainya seperti yang disorot.

[[dilindungi email] conf]# cat /etc/hadoop/conf/hdfs-site.xml

dfs.namenode.name.dir file:///data/1/dfs/nn,/nfsmount/dfs/nn

[[dilindungi email] conf]# cat /etc/hadoop/conf/hdfs-site.xml

dfs.datanode.data.dir file:///data/1/dfs/dn,/data/2/dfs/dn,/data/3/dfs/dn

Jalankan perintah di bawah ini untuk membuat struktur direktori & mengelola izin pengguna pada mesin Namenode (Master) dan Datanode (Node).

[[dilindungi email]]# mkdir -p /data/1/dfs/nn /nfsmount/dfs/nn. [[dilindungi email]]# chmod 700 /data/1/dfs/nn /nfsmount/dfs/nn

[[dilindungi email]]# mkdir -p /data/1/dfs/dn /data/2/dfs/dn /data/3/dfs/dn /data/4/dfs/dn. [[dilindungi email]]# chown -R hdfs: hdfs /data/1/dfs/nn /nfsmount/dfs/nn /data/1/dfs/dn /data/2/dfs/dn /data/3/dfs/dn /data/4 /dfs/dn

Format Namenode (pada Master), dengan mengeluarkan perintah berikut.

[[dilindungi email] conf]# sudo -u hdfs hdfs namenode -format

Tambahkan properti berikut ke hdfs-site.xml file dan ganti nilai seperti yang ditunjukkan pada Master.

dfs.namenode.http-address 172.21.17.175:50070 Alamat dan port yang akan didengarkan oleh NameNode UI.

Catatan: Dalam nilai kasus kami harus alamat ip master VM.

Sekarang mari kita gunakan MRv1 ( Pengurangan peta versi 1 ). Membuka 'mapred-site.xml' file berikut nilai-nilai seperti yang ditunjukkan.

[[dilindungi email] conf]# cp hdfs-site.xml mapred-site.xml. [[dilindungi email] conf]# vi mapred-site.xml. [[dilindungi email] conf]# cat mapred-site.xml

1.0 teks/xslkonfigurasi.xsl mapred.job.tracker tuan: 8021

Selanjutnya, salin 'mapred-site.xml' file ke mesin node menggunakan perintah scp berikut.

[[dilindungi email]conf]# scp /etc/hadoop/conf/mapred-site.xml simpul:/etc/hadoop/conf/ mapred-site.xml 100% 200 0.2KB/s 00:00

Sekarang konfigurasikan direktori penyimpanan lokal untuk digunakan oleh MRv1 Daemon. Buka lagi'mapred-site.xml' dan buat perubahan seperti yang ditunjukkan di bawah ini untuk setiap TaskTracker.

mapred.local.dir Â/data/1/mapred/local,/data/2/mapred/local,/data/3/mapred/local

Setelah menentukan direktori ini di 'mapred-site.xml', Anda harus membuat direktori dan menetapkan izin file yang benar untuk mereka di setiap node di cluster Anda.

mkdir -p /data/1/mapred/local /data/2/mapred/local /data/3/mapred/local /data/4/mapred/local. chown -R mapred: hadoop /data/1/mapred/local /data/2/mapred/local /data/3/mapred/local /data/4/mapred/local

Sekarang jalankan perintah berikut untuk memulai HDFS pada setiap node di cluster.

[[dilindungi email] conf]# untuk x di `cd /etc/init.d; ls hadoop-hdfs-*`; lakukan sudo service $x start; selesai

[[dilindungi email] conf]# untuk x di `cd /etc/init.d; ls hadoop-hdfs-*`; lakukan sudo service $x start; selesai

Hal ini diperlukan untuk membuat /tmp dengan izin yang tepat persis seperti yang disebutkan di bawah ini.

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -mkdir /tmp. [[dilindungi email] conf]# sudo -u hdfs hadoop fs -chmod -R 1777 /tmp

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -mkdir -p /var/lib/hadoop-hdfs/cache/mapred/mapred/staging. [[dilindungi email] conf]# sudo -u hdfs hadoop fs -chmod 1777 /var/lib/hadoop-hdfs/cache/mapred/mapred/staging. [[dilindungi email] conf]# sudo -u hdfs hadoop fs -chown -R mapred /var/lib/hadoop-hdfs/cache/mapred

Sekarang verifikasi struktur File HDFS.

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -ls -R / drwxrwxrwt - hdfs hadoop 0 29-05-2014 09:58 /tmp. drwxr-xr-x - hdfs hadoop 0 29-05-2014 09:59 /var. drwxr-xr-x - hdfs hadoop 0 29-05-2014 09:59 /var/lib. drwxr-xr-x - hdfs hadoop 0 29-05-2014 09:59 /var/lib/hadoop-hdfs. drwxr-xr-x - hdfs hadoop 0 29-05-2014 09:59 /var/lib/hadoop-hdfs/cache. drwxr-xr-x - mapred hadoop 0 29-05-2014 09:59 /var/lib/hadoop-hdfs/cache/mapred. drwxr-xr-x - mapred hadoop 0 29-05-2014 09:59 /var/lib/hadoop-hdfs/cache/mapred/mapred. drwxrwxrwt - dipetakan hadoop 0 29-05-2014 09:59 /var/lib/hadoop-hdfs/cache/mapred/mapred/staging

Setelah Anda memulai HDFS dan membuat '/tmp‘, tetapi sebelum Anda memulai JobTracker, harap buat direktori HDFS yang ditentukan oleh parameter ‘mapred.system.dir’ (secara default ${hadoop.tmp.dir}/mapred/system dan ubah pemilik menjadi mapred.

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -mkdir /tmp/mapred/system.conf [[dilindungi email] conf]# sudo -u hdfs hadoop fs -chown mapred: hadoop /tmp/mapred/system

Untuk memulai MapReduce: silakan mulai layanan TT dan JT.

[[dilindungi email]conf]# service hadoop-0.20-mareduce-tasktracker start Memulai Tasktracker: [ OK ] memulai pelacak tugas, masuk ke /var/log/hadoop-0.20-mapreduce/hadoop-hadoop-tasktracker-node.out

[[dilindungi email] conf]# service hadoop-0.20-mapreduce-jobtracker start Memulai Jobtracker: [ OK ] memulai jobtracker, masuk ke /var/log/hadoop-0.20-mapreduce/hadoop-hadoop-jobtracker-master.out

Selanjutnya, buat direktori home untuk setiap pengguna hadoop. Anda disarankan untuk melakukan ini di NameNode; Misalnya.

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -mkdir /user/[[dilindungi email] conf]# sudo -u hdfs hadoop fs -chown /user/

Catatan: di mana nama pengguna Linux setiap pengguna.

Atau, Anda dapat membuat direktori home sebagai berikut.

[[dilindungi email] conf]# sudo -u hdfs hadoop fs -mkdir /user/$USER.conf [[dilindungi email] conf]# sudo -u hdfs hadoop fs -chown $USER /user/$USER

Buka browser Anda dan ketik url sebagai http://ip_address_of_namenode: 50070 untuk mengakses Namenode.

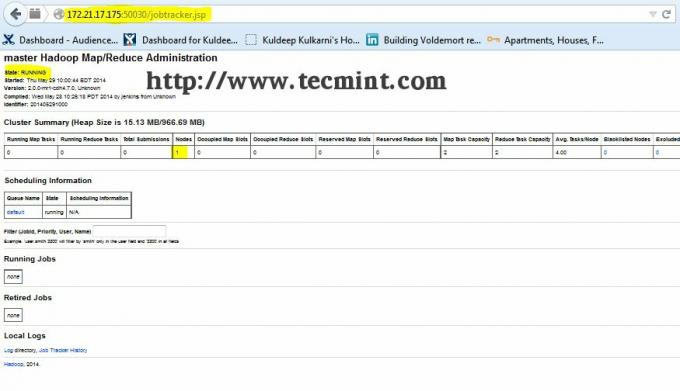

Buka tab lain di browser Anda dan ketik url sebagaihttp://ip_address_of_jobtracker: 50030 untuk mengakses JobTracker.

Prosedur ini telah berhasil diuji pada RHEL/CentOS 5.X/6.X. Silakan komentar di bawah jika Anda menghadapi masalah dengan instalasi, saya akan membantu Anda dengan solusi.