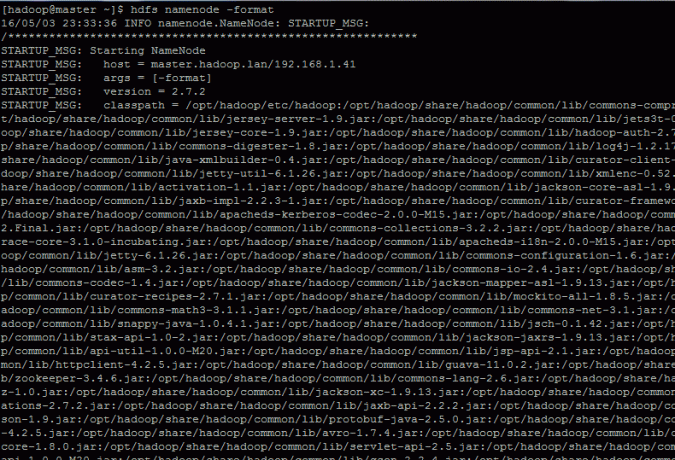

17. Setelah kluster node tunggal hadoop telah disiapkan, saatnya untuk menginisialisasi sistem file HDFS dengan memformat file /opt/volume/namenode direktori penyimpanan dengan perintah berikut:

$ hdfs namenode -format.

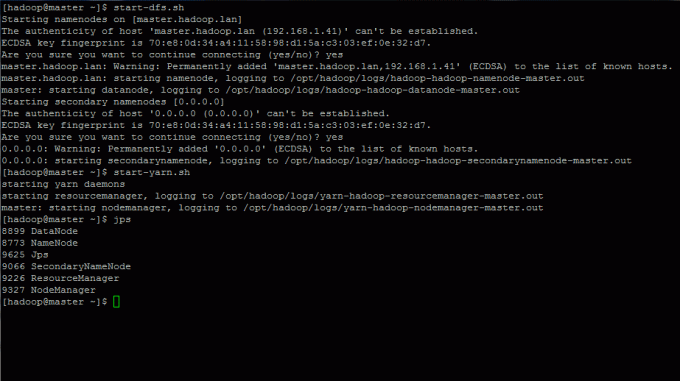

18. Perintah Hadoop terletak di $HADOOP_HOME/sbin direktori. Untuk memulai layanan Hadoop, jalankan perintah di bawah ini di konsol Anda:

$ mulai-dfs.sh. $ mulai-benang.sh.

Periksa status layanan dengan perintah berikut.

$jps.

Atau, Anda dapat melihat daftar semua soket terbuka untuk Apache Hadoop di sistem Anda menggunakan ss memerintah.

$ ss -tul. $ ss -tuln # Keluaran numerik.

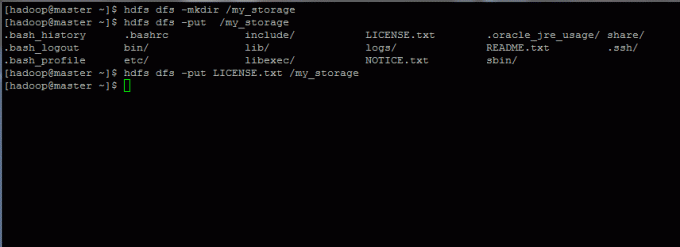

19. Untuk menguji cluster sistem file hadoop, buat direktori acak di sistem file HDFS dan salin file dari sistem file lokal ke HDFS penyimpanan (masukkan data ke HDFS).

$ hdfs dfs -mkdir /my_storage. $ hdfs dfs -masukkan LICENSE.txt /my_storage.

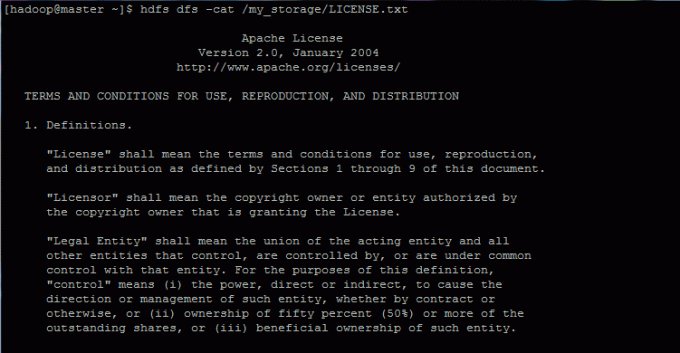

Untuk melihat konten file atau daftar direktori di dalam sistem file HDFS, jalankan perintah di bawah ini:

$ hdfs dfs -cat /my_storage/LICENSE.txt. $ hdfs dfs -ls /my_storage/

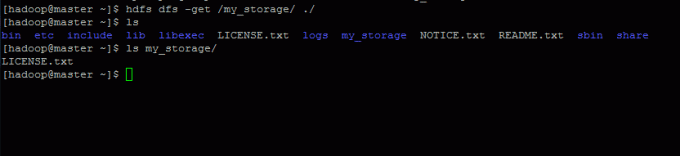

Untuk mengambil data dari HDFS ke sistem file lokal kami, gunakan perintah di bawah ini:

$ hdfs dfs -get /my_storage/ ./

Dapatkan daftar lengkap opsi perintah HDFS dengan mengeluarkan:

$ hdfs dfs -bantuan.

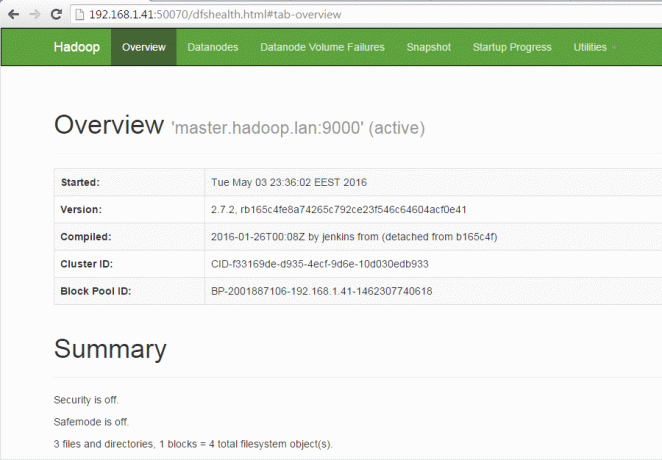

20. Untuk mengakses layanan Hadoop dari browser jarak jauh, kunjungi tautan berikut (ganti Alamat IP FQDN yang sesuai). Juga, pastikan port di bawah ini terbuka di firewall sistem Anda.

Untuk Ikhtisar Hadoop layanan NameNode.

http://192.168.1.41:50070

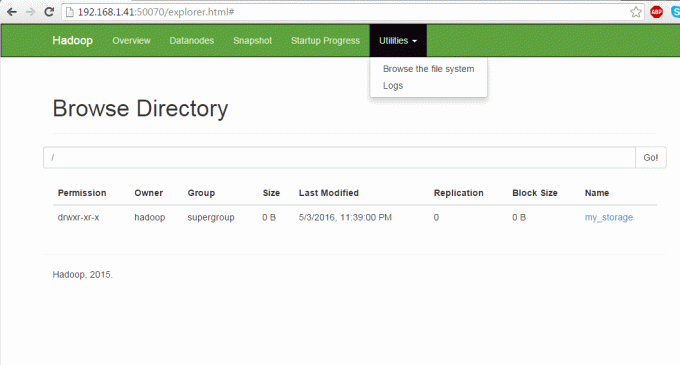

Untuk penjelajahan sistem file Hadoop (Jelajahi Direktori).

http://192.168.1.41:50070/explorer.html.

Untuk Informasi Cluster dan Aplikasi (ResourceManager).

http://192.168.1.41:8088

Untuk Informasi NodeManager.

http://192.168.1.41:8042

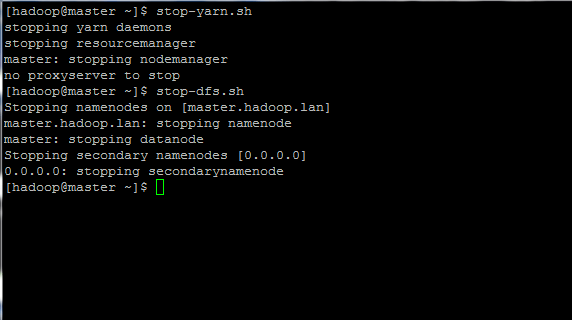

21. Untuk menghentikan semua instance hadoop, jalankan perintah di bawah ini:

$ stop-benang.sh. $ stop-dfs.sh.

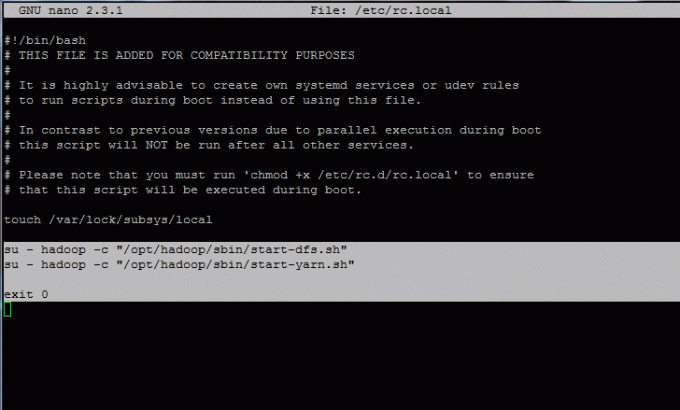

22. Untuk mengaktifkan daemon Hadoop di seluruh sistem, login dengan pengguna root, buka /etc/rc.local file untuk diedit dan tambahkan baris di bawah ini:

$su - root. # vi /etc/rc.local.

Tambahkan kutipan ini ke rc.local mengajukan.

su - hadoop -c "/opt/hadoop/sbin/start-dfs.sh" su - hadoop -c "/opt/hadoop/sbin/start-yarn.sh" keluar 0.

Kemudian, tambahkan izin yang dapat dieksekusi untuk rc.local file dan aktifkan, mulai dan periksa status layanan dengan mengeluarkan perintah di bawah ini:

$ chmod +x /etc/rc.d/rc.local. $ systemctl aktifkan rc-local. $ systemctl mulai rc-local. $ systemctl status rc-local.

Itu dia! Lain kali kamu menyalakan ulang mesin Anda hadoop layanan akan dimulai secara otomatis untuk Anda! Yang perlu Anda lakukan adalah menjalankan aplikasi yang kompatibel dengan Hadoop dan Anda siap untuk pergi!

Untuk informasi tambahan, silakan berkonsultasi dengan pejabat Dokumentasi Apache Hadoop halaman web dan Hadoop Wiki halaman.